En août 2022 une révélation bouleverse les mondes de l’art et du numérique : l’IA MidJourney gagne le prix des « artsnumériques » avec une œuvre inédite ! Cela prouve que l’IA est capable de créer des dessins ultraréalistes. Comment l’IA peut-elle copier des dessins et imaginer des créations artistiques originales ? Quelles technologies utilise l’IA pour dessiner ? C’est le sujet de ce billet.

IA qui es-tu?

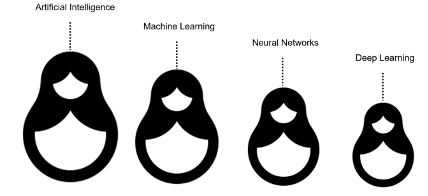

L’intelligence artificielle (IA) utilise la technologie du Machine Learning qui permet aux ordinateurs d’apprendre par eux-mêmes à partir de données fournies en input. L’IA utilise le Deep Learning pour créer des réseaux de neurones artificiels (« Neural Nets ») capables d’apprentissage. Basés sur la structure des neurones humains les Neural Nets sont utilisés pour traiter des données et résoudre des problèmes (Zhang & al. 2022).

Comment un Neural Net reconnaît et reproduit des images?

La composition d’un Neural Net

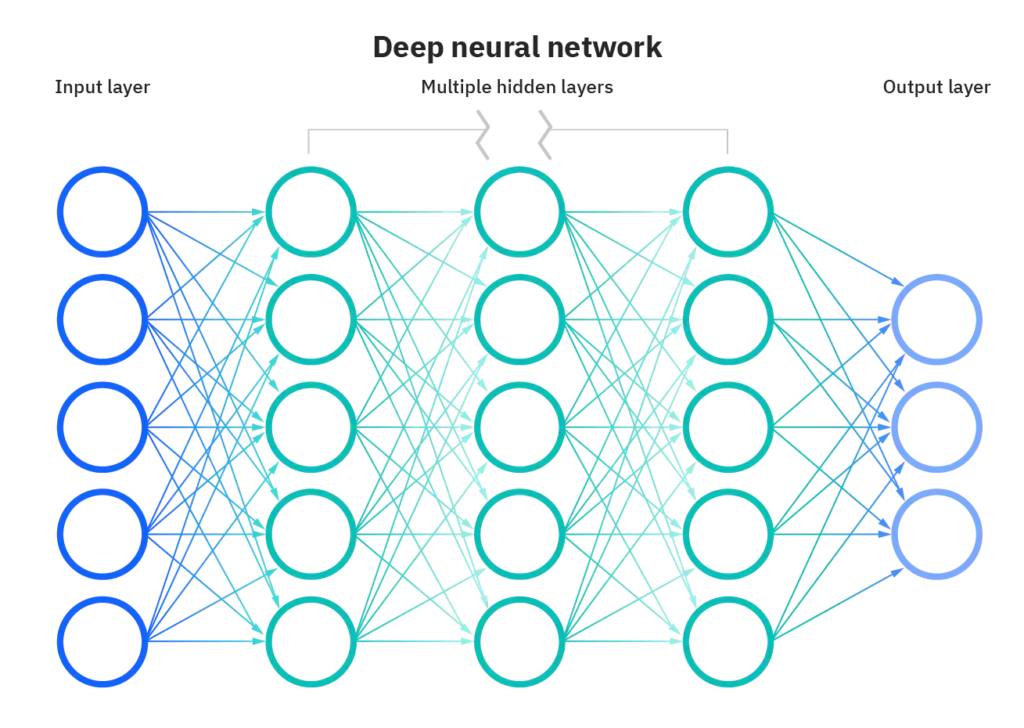

Un Neural Net est composé de 3 couches («layers»):

- L’input réceptionne les données

- Les hidden layers traitent les données

- L’output les transcrit

Un Neural Net est simple s’il contient un seul hidden layer; il est complexe s’il comporte entre 3 et 9 hidden layers (Kavlakoglu 2020; Peng 2022). Dans un Neural Net complexe l’output d’un hidden layer devient l’input du hidden layer suivant, et ainsi de suite jusqu’à ce que l’information traverse tous les hidden layers et arrive à l’output où elle est retranscrite.

Le Neural Net à l’école de l’IA

Comme l’enfant apprend le dessin, le Neural Net apprend à identifier les caractéristiques («patterns» ou «features»: Peng 2022; Yurman 2022) d’un dataset d’images. Le Neural Net décompose l’image en patterns (points, traits, courbes) codés en pixel dans les hidden layers. C’est en combinant les patterns comme des pièces de puzzle, que le Neural Net est capable de composer un dessin.

Exemple: entrainons un Neural Net à dessiner un chat.

Etape 1 «supervised learning» : on fournit au Neural Net un dataset d’entrainement avec des dessins de chats. Au début de l’apprentissage le Neural Net aveugle ne voit pas les patterns. Pour comprendre les dessins, le Neural Net décompose en pixels les patterns des dessins et les mémorise dans ses hidden layers (Peng 2022; Yurman 2022).

Etape 2: on fournit au Neural Net un 2e dataset avec des dessins différents du dataset d’entrainement. Le modèle fait une prédiction, et associe à chaque pattern un «poids» qui s’alourdit ou s’allège selon que le pattern appris par le modèle est correctement identifié (Kavlakoglu 2020).

Etape 3: le Neural Net compare sa prédiction avec les dessins d’input. Si la prédiction est juste, le modèle a identifié les bons patterns et renvoie un dessin cohérent. Si la prédiction est fausse, le modèle corrige son erreur en modifiant le «poids» de chaque pattern. Les poids sont comparables aux muscles du corps: un Neural Net bien entrainé a des muscles forts et des poids bien calibrés qui identifient correctement chaque pattern d’un dessin. Donc une bonne prédiction augmente les poids, et une mauvaise prédiction les diminue.

Plus le Neural Net s’entraine, prédit et se corrige, plus il apprend et s’améliore. Il devient capable de traiter de nouvelles données et créer des oeuvres inédites comme le fait l’IA MidJourney.

Quels composants des Neural Nets permettent à l’IA de dessiner?

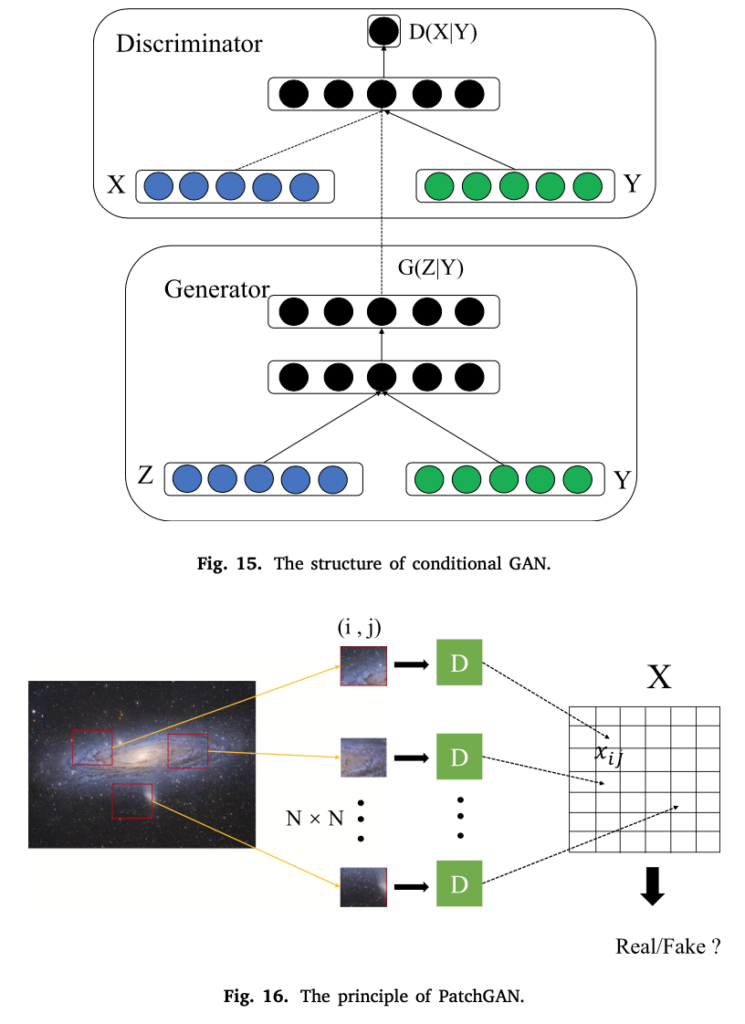

Nous avons vu le principe d’un réseau de neurones simple, comme l’IA QuickDraw qui se nourrit des dessins proposés par l’humain pour prédire l’objet dessiné. Mais l’IA peut aussi utiliser un GAN«Generative Adversarial Net» qui assemble plusieurs réseaux de neurones mis en concurrence.

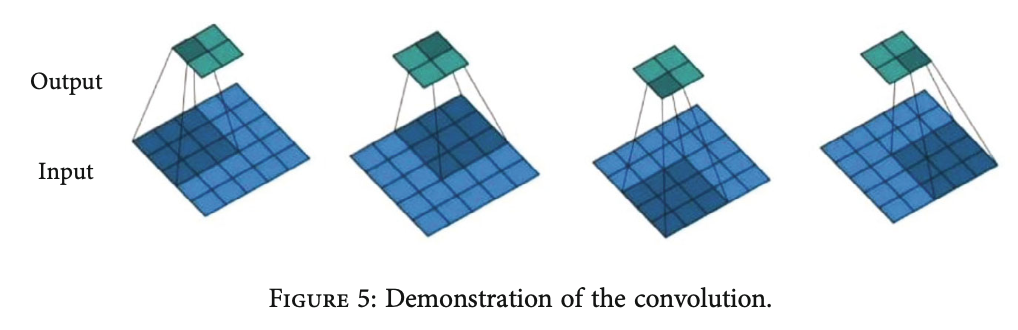

Un GAN comporte un «Convoluted Neural Net» (CNN) confronté à un «Deconvolutional Neural Net» (DNN)

• Le CNN classe des données pixelisées et reconnait des dessins. Exemple: dessins de chiens et chats.

• Le DNN a l’objectif inverse: il génère des dessins depuis le mot écrit «chat» ou «chien» qu’il a identifié.

Confronté au CNN, le DNN s’entraine a créer des dessins réalistes, avant de soumettre son dessin au CNN qui décide si c’est cohérent ou non.

Ainsi, il semble que le secret de l’IA soit inscrit dans le GAN dont la créativité simule celle de l’humain (Yurman 2022). Plus le GAN compare et mémorise des patterns de dessins, plus sa compréhension s’affine, lui permettant de mieux interpréter les dessins.

Il s’en inspire et s’en abstrait pour créer des œuvres d’art inédites. Ainsi l’IA contribue aux processus créatifs à travers des applications comme AI-Sketcher (Cao & al. 2020), Dall-e, MidJourney, QuickDraw. Ces modèles d’AI apprennent des séquences de patterns précis qu’ils ont intégré dans leurs hidden layers. Ils peuvent ainsi générer un dessin artificiel de chat très réaliste.

CONCLUSION

Traitant une grande quantité de données, les Neural Nets apprennent à reconnaitre des «patterns» pour créer des dessins, ce qui permet à l’IA de développer de surprenantes capacités, allant de l’esquisse à l’œuvre d’art. L’IA nous permet de dessiner, et nous soutient dans nos tâches quotidiennes, notamment grâce aux assistants virtuels, basés sur l’IA. Ainsi, pourrait-t-on imaginer qu’un jour nos assistants SIRI, Alexa, OK Google soient capables d’utiliser les Neural Network pour dessiner directement sur nos écrans, ce que l’utilisateur lui demande? Et si un jour SIRI devenait capable de «dessiner un mouton»?

BIBLIOGRAPHIE

- AI vs. Machine Learning vs. Deep Learning vs. Neural Networks: What’s the Difference?, KAVLAKOGLU, Eda [sans date]. [en ligne]. [Consulté le 19 novembre 2022]. Disponible à l’adresse: https://www.ibm.com/cloud/blog/ai-vs-machine-learning-vs-deep-learning-vs- neural-networks

- CAO, Nan, YAN, Xin, SHI, Yang et CHEN, Chaoran, 2019. AI-Sketcher : A Deep Generative Model for Producing High-Quality Sketches. Proceedings of the AAAI Conference on Artificial Intelligence. [en ligne]. 17 juillet 2019. Vol. 33, no. 01, pp. 2564-2571. [Consulté le 19 novembre 2022]. DOI 10.1609/aaai.v33i01.33012564.

- DALL·E 2, [sans date]. OpenAI. [en ligne]. [Consulté le 19 novembre 2022]. Disponible à l’adresse: https://openai.com/dall-e-2/

- Midjourney, [sans date]. Midjourney. [en ligne]. [Consulté le 19 novembre 2022]. Disponible à l’adresse: https://www.midjourney.com/

- MidJourney | Comment l’IA crée des images, [sans date]. MokaMag. [en ligne]. [Consulté le 19 novembre 2022]. Disponible à l’adresse: https://www.moka- mag.com/articles/midjourney

- MOHAMMED, Amal Ahmed Hasan et CHEN, Jiazhou, 2022. Cleanup Sketched Drawings: Deep Learning-Based Model. ALGALIL, Fahd Abd (éd.), Applied Bionics and Biomechanics. [en ligne]. 6 mai 2022. Vol. 2022, pp. 1-17. [Consulté le 17 novembre 2022]. DOI 10.1155/2022/2238077.

- PENG, Yuanbo, 2022. Digital Recognition Methods Based on Deep Learning. LI, Lianhui (éd.), Scientific Programming. [en ligne]. 25 juillet 2022. Vol. 2022, pp. 1-12. [Consulté le 17 novembre 2022]. DOI 10.1155/2022/9691331.

- Quick, Draw!, [sans date]. [en ligne]. [Consulté le 19 novembre 2022]. Disponible à l’adrese:https://quickdraw.withgoogle.com/

- YURMAN, Paulina et REDDY, Anuradha Venugopal, 2022. Drawing Conversations Mediated by AI. In: Creativity and Cognition. [en ligne]. Venice Italy: ACM. 20 juin 2022. pp. 56-70. [Consulté le 19 novembre 2022]. ISBN 9781450393270. DOI 10.1145/3527927.3531448.

- ZHANG, Xiaobo, ZHAI, Donghai, LI, Tianrui, ZHOU, Yuxin et LIN, Yang, 2023. Image inpainting based on deep learning: A review. Information Fusion. [en ligne]. février 2023. Vol. 90, pp. 74-94. [Consulté le 17 novembre 2022]. DOI 10.1016/j.inffus.2022.08.033.

Laisser un commentaire