Les fondements (ou “jeu” pense donc je suis …)

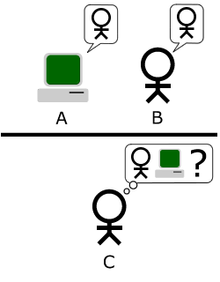

C’est à Alan Turing que l’on doit d’avoir énoncé les fondations du machine learning [1], branche de l’intelligence artificielle (IA). Dans son article Computing machinery and intelligence (Turing 1950) paru dans la revue Mind, il s’intéresse à la question de savoir si une machine, en plus de faire des calculs complexes, est capable de réfléchir, ce qu’il formalise par: “Can machines think ?” Une machine intelligente (qui penserait) serait, selon lui, capable de tromper un humain en lui faisant croire qu’elle est elle-même humaine. Il imagine alors le jeu de l’imitation (ou test de Turing), dans lequel un interrogateur, en posant à l’aveugle des questions à un humain et à une machine, tente de deviner lequel des deux est humain. Alan Turing expose alors comment, selon lui, la machine doit être programmée pour tromper l’interrogateur.

Figure 1: Le jeu de l’imitation d’Alan Turing (aussi appelé test de Turing).

(Source: Bilby [Public domain], from Wikimedia Commons).

Pour dépasser les limitations techniques de l’époque, il suggère de faire en sorte que son fonctionnement simule le cerveau d’un enfant. On l’“éduquerait” ensuite pour qu’elle se développe jusqu’au niveau de maturité d’un cerveau adulte. Une des méthodes possibles serait basée sur un système de “punitions” et de “récompenses”. Une autre utiliserait un système logique de règles, dans le cadre duquel la machine peut concevoir avec une certaine liberté sa propre démarche et choisir les actions intermédiaires permettant d’aboutir au résultat demandé tout en respectant les règles imposées dans le système. Certaines de ces règles peuvent même évoluer dans le temps ou disparaître lorsqu’elles ne sont plus utiles. Alan Turing suggère aussi d’inclure une composante aléatoire dans le processus d’apprentissage, qui rendrait plus efficace la résolution par la machine de certains problèmes que l’utilisation d’une méthode systématique.

Il envisage également que dans un futur proche la machine devienne son propre sujet d’étude, conçoive ses propres programmes, et à partir d’observations sur elle-même, modifie ceux-ci pour aboutir avec plus de succès au résultat souhaité. Et outre le fait d’apprendre par elle-même, elle serait également capable de faire autre chose que ce qu’on lui demande de faire.

Figure 2: Prototype de Automatic Computing Engine (ACE), conçu par Alan Turing alors que celui-ci travaille pour le National Physics Laboratory (1945-1948). Ce prototype exécute son premier programme en mai 1950.

(Source: Alan Turings Science Museum Group Collection © The Board of Trustees of the Science Museum)

L’héritage

“We may hope that machines will eventually compete with men in all purely intellectual fields” (Turing 1950, p. 460). Près de 70 ans plus tard, on connaît le développement de la discipline et les nombreuses applications de l’IA dans de multiples domaines. Pour ne citer qu’un exemple emblématique, en 2017 le programme AlphaGo Zero devient le champion du monde de jeu de Go en ayant fait son apprentissage seul. Plusieurs des concepts qu’Alan Turing introduit et développe ont été fondateurs pour les débuts de la discipline de l’IA (McCarthy 1955) et sont toujours en vigueur (Moor 2006) [2].

Et l’éthique dans tout ça ?

Dans son article, Alan Turing détaille aussi les critiques qui se sont élevées à propos de sa vision de cette machine qui réfléchit. Outre celles d’ordre moral ou religieux, mathématique, technique, l’une de ces critiques touche à la question de la conscience et des émotions. Etre capable de penser, c’est pouvoir s’observer penser, être conscient que l’on pense soi-même. Pour être sûr qu’une machine pense, il faudrait donc être la machine soi-même et se sentir penser. Et pour que la machine soit considérée comme l’équivalent d’un cerveau humain, il faudrait qu’elle ait des pensées mais aussi qu’elle ressente des émotions (on pourrait d’ailleurs ajouter qu’il faudrait qu’elle soit capable d’imagination, de créativité, …). Même si Alan Turing écarte cette critique en disant qu’on n’a pas besoin d’élucider les mystères sur la conscience pour étudier sa question initiale, on touche là à un point crucial: la machine telle que la conçoit Alan Turing pourrait-elle un jour se comporter de la façon ci-dessus ? Etait-ce (est-ce) envisageable, souhaitable ?

A l’époque, certaines personnes rejettent aussi a priori l’idée qu’une machine puisse penser, à cause des conséquences trop terribles que son existence impliquerait, en particulier, la perte de la position de domination intellectuelle par l’humain. En 2006, certains participants à “The Dartmouth College Artificial Intelligence Conference” espéraient que les machines restent toujours dominées par les humains (Moor 2006).

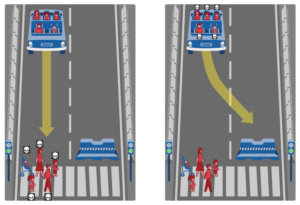

Lors des séminaires de ce premier semestre du Master en Sciences de l’Information, on a souvent entendu parler d’éthique et de risques d’ordre éthique, en particulier à propos des thèmes ayant un lien avec l’IA (décisions “morales” à prendre par les voitures autonomes par exemple).

Figure 3: L’apprentissage des programmes d’IA pour voitures automatiques à partir de différents scénarios: qui doit être sacrifié, qui doit être épargné ?

Figure 3: L’apprentissage des programmes d’IA pour voitures automatiques à partir de différents scénarios: qui doit être sacrifié, qui doit être épargné ?

(Source: http://moralmachine.mit.edu/)

L’intelligence artificielle a-t-elle pris trop de place dans nos sociétés, lui confie-t-on trop de tâches ? Ou au contraire, peut-on maintenant concevoir de pousser le développement des programmes pour qu’ils acquièrent aussi des capacités leur permettant d’adopter d’eux-mêmes un comportement éthique ?

Alan Turing était certainement un scientifique génial et un visionnaire dans son domaine, néanmoins dans cet article de 1950, il soulève peu lui-même les limites et dérives possibles de son sujet d’étude. Peut-être était-ce encore trop tôt: “We can only see a short distance ahead, but we can see plenty there that needs to be done” (Turing 1950, p. 460) … mais il est temps maintenant de réconcilier potentialités de l’IA et risques éthiques pour nos sociétés.

Notes

[1] On choisit d’utiliser ici et dans la suite l’expression “machine learning” plutôt que “apprentissage automatique”.

[2] En 1956, eut lieu “The Dartmouth Summer Research Project on Artificial Intelligence”, initiative reconnue comme fondatrice pour le lancement de la recherche en IA. Il reste peu de trace des résultats de ce projet, hormis un document de présentation du projet (McCarthy 1955). En 2006 s’est déroulée “The Dartmouth College Artificial Intelligence Conference: The Next Fifty Years” (Moor 2006), dont l’un des objectifs était de célébrer les 50 ans du “Dartmouth Summer Research Project on Artificial Intelligence”.

Bibliographie

McCarthy, John, Minsky, Marvin L., Rochester, Nathaniel et Shannon, Claude, E., 1955. A proposal for the Dartmouth Summer Research Project on Artificial Intelligence, August 31, 1955. Disponible à l’adresse: http://jmc.stanford.edu/articles/dartmouth/dartmouth.pdf

Moor, James, 2006. The Dartmouth College Artificial Intelligence Conference: The Next Fifty Years, AI Magazine. Vol. 27, n° 4, pp. 87-91. Disponible à l’adresse: https://pdfs.semanticscholar.org/d486/9863b5da0fa4ff5707fa972c6e1dc92474f6.pdf

Turing, A. M., 1950. I.- Computing machinery and intelligence. Mind, a quarterly review of psychology and philosophy. Vol. LIX, N°236, pp. 433-460. ISSN 0026-4423. Disponible à l’adresse: https://academic.oup.com/mind/article/LIX/236/433/986238

Références supplémentaires

ALBERT, Sophie, BEN-ZEEV, Nimrod, BOUAZZAOUI, Oumaima, et DRUEY, Guy, 2018. Séminaire : Machine Learning [présentation Prezi]. Support de cours : Cours séminaires, Master en Sciences de l’information, Haute école de gestion de Genève. 23 novembre 2018. [Consulté le 16 décembre 2018]. Disponible à l’adresse: https://prezi.com/view/aCUJlKzQT3Djz0uj5gjV/.

European Group on Ethics in Science and New Technologies, European Commission, 2018. Statement on Artificial Intelligence, Robotics and ‘Autonomous’ Systems [en ligne]. Brussels: European Union. ISBN: SBN 978-92-79-80329-1. [Consulté le 16 décembre 2018]. Disponible à l’adresse: http://ec.europa.eu/research/ege/pdf/ege_ai_statement_2018.pdf

KISSINGER, Henry, 2018. Comment les Lumières finissent. Le Débat. Novembre-décembre 2018. 2018/5, n°202, pp. 81-86.

(“Comment définir la conscience dans un monde de machines ?”)

Trois lois de la robotique. In: Wikipédia [en ligne]. Dernière modification de cette page le 10 décembre 2018 à 15:59. https://fr.wikipedia.org/wiki/Trois_lois_de_la_robotique#De_la_possibilit%C3%A9_d’appliquer_des_lois_%C3%A0_une_intelligence [consultée le 16 décembre 2018].

(Les lois de la robotique telles qu’énoncées par Isaac Isamov, auteur de science-fiction, et qui s’appliquent aux robots de ses romans.)

Remerciements

Ce billet de blog a pour point de départ le séminaire sur le machine learning donné le 23 novembre 2018 à la HEG par des étudiant-e-s du Master en Sciences de l’Information (Albert 2018). Je remercie Sophie Albert, Oumaima Bouazzaoui, Guy Druey, et tout particulièrement Nimrod Ben-Zeev pour leur présentation et l’intérêt qu’ils ont suscité en moi pour le sujet. Je remercie également Magali Pittet et d’autres camarades du Master qui ont abordé des questions d’ordre éthique lors de leur séminaire.

Laisser un commentaire