Temps de lecture : 8 min

Introduction : Une symphonie de données

Imaginez un orchestre jouant une symphonie. Chaque musicien, du violoniste au percussionniste, a un rôle spécifique, mais c’est le chef d’orchestre qui guide l’ensemble pour créer une harmonie parfaite. Maintenant, transposez cette image au monde de l’intelligence artificielle : chaque « musicien » devient un neurone, chaque partition est une donnée, et le réseau de neurones, tel un orchestre, transforme le chaos en quelque chose de compréhensible et utile.

Les réseaux de neurones avancés (RNA) orchestrent déjà une grande partie de nos vies : ils traduisent des langues, reconnaissent des visages, et même créent des œuvres d’art. Dans ce billet, nous allons découvrir comment ils fonctionnent, où ils brillent, et les défis qu’ils doivent relever.

Comprendre les réseaux de neurones avancés : construire une harmonie

Un réseau de neurones est comme un orchestre bien réglé. Chaque couche de neurones joue un rôle, comme des sections d’un orchestre (cordes, vents, percussions). Mais pour obtenir une sortie précise, il faut un apprentissage, équivalent aux répétitions nécessaires avant un concert.

Les bases : chaque neurone a sa note

- Couches d’entrée : Comme les partitions que chaque musicien reçoit, cette couche contient les données brutes (images, sons, texte).

- Couches cachées : Les musiciens jouent leur partie, transformant les notes en mélodies. Ici, les couches cachées traitent et interprètent les données.

- Couche de sortie : Le résultat final est comme la symphonie terminée, une décision ou une prédiction.

L’attention : un chef d’orchestre révolutionnaire

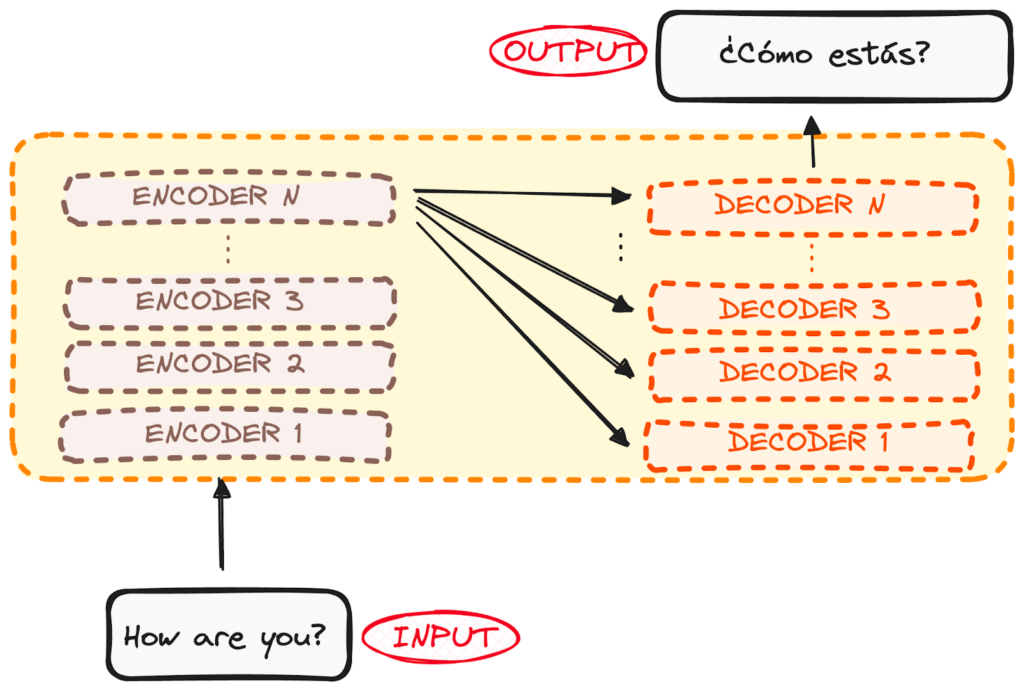

Avec les réseaux avancés, comme les transformers, le chef d’orchestre (le mécanisme d’attention) a pris une importance clé. Selon l’article « Attention Is All You Need », l’attention permet au réseau de se concentrer sur les sections importantes des données, un peu comme un chef met en avant les cordes dans un moment crucial.

Application : Quand l’orchestre joue pour nous

Chaque jour, cet orchestre invisible travaille en coulisses pour transformer nos vies. Voici quelques-unes de ses performances les plus impressionnantes :

-

Vision par ordinateur : Comme un orchestre interprétant une image complexe, les réseaux analysent les pixels pour reconnaître des visages ou détecter des objets. ArXiv décrit comment les transformeurs améliorent ces performances en analysant les images en contextes globaux, comme un chef coordonnant toutes les sections pour un final spectaculaire.

-

Traitement du langage naturel : Lorsque vous parlez à un assistant vocal, il traduit vos mots en données, les traite, et répond avec fluidité. Les transformeurs, comme GPT, sont les virtuoses dans ce domaine.

- Création artistique : Avec les GANs (Generative Adversial Networks ou réseaux antagonistes génératifs), les machines deviennent des compositeurs. Cet article explore comment les GANs recréent des œuvres culturelles perdues, comme si l’orchestre improvisait une œuvre d’art à partir d’une mélodie oubliée.

Défis : Quand l’orchestre perd la partition

Même un orchestre talentueux peut faire des fausses notes. Les réseaux de neurones, malgré leur puissance, ont leurs limites.

Boîtes noires et erreurs

Les RNA sont souvent comparés à des « boîtes noires » : on voit la sortie, mais il est difficile de comprendre exactement comment ils y sont arrivés. Dans des domaines critiques comme la médecine, cette opacité peut poser problème. Par exemple, dans le diagnostic des troubles neurologiques, un réseau peut détecter une anomalie mais ne pas expliquer pourquoi. Cela complique la validation et l’adoption de ces technologies en clinique. Ce rapport explore ces défis en profondeur et propose des solutions pour améliorer la transparence des modèles. Petit aperçu en vidéo.

Biais et éthique

Un chef d’orchestre peut favoriser certaines sections au détriment d’autres. De même, les réseaux de neurones peuvent reproduire des biais présents dans leurs données d’entraînement. Des biais dans les modèles d’embauche, par exemple, peuvent discriminer des candidats en fonction de leur genre ou origine.

Environnement

L’entraînement de ces orchestres numériques consomme énormément d’énergie. Cet article sur ArXiv propose des solutions comme l’utilisation de modèles plus légers, le partage de poids entre couches, et l’entraînement réparti sur des architectures distribuées. Ces approches permettent de réduire l’empreinte énergétique tout en maintenant des performances élevées.

Conclusion : L’avenir de l’orchestre

L’orchestre des réseaux de neurones n’en est qu’à ses premières symphonies. Alors que les transformeurs et GANs redéfinissent ce que les machines peuvent accomplir, de nouveaux chefs d’orchestre apparaîtront, plus éthiques, plus transparents, et plus responsables. En comprenant leur fonctionnement et leurs limites, nous pouvons participer à ce concert technologique et façonner un futur harmonieux.

Laisser un commentaire