Par Lorenzo Avellino & Delvinë Racaj

Nous avons pris l’habitude de pointer nos téléphones vers tout ce qui nous entoure : un visage familier, une façade ancienne, un objet intrigant. En un clin d’œil, l’image capturée est enrichie par des informations contextuelles générées automatiquement : reconnaissance d’objets, identification de lieux, détection de visages. Est-il possible d’utiliser ces technologies reposant sur des algorithmes de machine learning aussi pour la description des fonds photographiques conservés dans les institutions patrimoniales ?

CC BY-SA · Donald Trung Quoc Don, 2023. Text recognition software on a photograph – Google Lens

Le machine learning pour les archives photographiques

Cette question est au centre de plusieurs tentatives menées ces dernières années dans le but d’automatiser l’identification d’objets, de lieux et de personnages. L’intelligence artificielle (IA) manque en effet des compétences historiques et culturelles nécessaires pour interpréter les images dans leurs contextes propres. D’autant que, comme l’explique Emily Bender, linguiste informatique et professeure à l’Université de l’Etat de Washington, l’IA n’est que un « perroquet stochastique sans faculté de raisonnement » : le machine learning crée l’illusion d’intelligence par sa capacité de prédire le contenu souhaité, mais ne possède pas de réelle capacité analytique. Basée sur la vision par ordinateur, cette technologie pourrait néanmoins sensiblement accélérer la description des photographies grâce au tagging automatique, à la reconnaissance d’objets, de lieux ou de textes. Dans les projets pilotes menés ces dernières années, le machine learning est utilisé comme premier niveau d’indexation. Les résultats produits sont ensuite vérifiés et enrichis par des archivistes et d’autres professionnel·les comme des historien·nes, ou autres spécialistes.

Un cas d’usage intéressant dans ce sens est celui de la bibliothèque de la Haute école polytechnique fédérale de Zurich (ETH), qui mène depuis 2021 un projet pilote d’autotagging d’un million d’images dans le cadre de la plateforme E-Pics. Après une phase de traitement automatique par le modèle général commercialisé par Clarifai, le projet suit une longue phase de contrôle qualité. En mars 2024, un premier constat en cours de route fait état de 1486 tags valides et 1877 tags invalides… pas incroyable ! Des chercheurs en sciences sociales dénoncent en outre le risque de renforcer des stéréotypes, tandis que les professionnels de l’information documentaire constatent des résultats limités et répétitifs, des balises erronées ainsi qu’un manque de clarté entre tags générés par l’IA et mots-clés attribués par des spécialistes, ce qui dévalorise leur expertise.

CC BY-SA · Nicole Graf, 2024. L’intelligence artificielle dans la description d’images: exemple pratique d’Archive d’images de l’EPFZ

IA et photo dans les archives du Montreux Jazz

Les technologies évoluent en revanche très vite donc nous avons décidé de mener une autre expérience sur l’usage de IA pour la description d’archives photographique dans le cadre du Master en Information Science. Le contexte dans lequel nous avons commencé à déployer ce projet de recherche est celui du Cultural Heritage & Innovation Center (CHC) de l’Ecole polytechnique Fédérale de Lausanne, un centre d’innovation dans les patrimoines culturels dont le projet phare est l’inventaire, la numérisation, la préservation et la valorisation des archives du festival musical Montreux Jazz. Après discussion avec les archivistes responsables, nous avons constaté que l’automatisation de la description des images est un domaine intéressant pour appliquer les nouvelles technologies de machine learning au vu des besoins de l’institution. Comme ailleurs, l’augmentation exponentielle des archives nativement numériques a créé un défi inédit pour les professionnels de l’information documentaire, les méthodes conventionnelles de description se révélant aujourd’hui insuffisantes. Ainsi l’écrasante majorité des prises du Montreux Jazz conservées par le CHC ne sont accompagnées que d’informations sommaires telles que le format du fichier, la date et l’auteur.

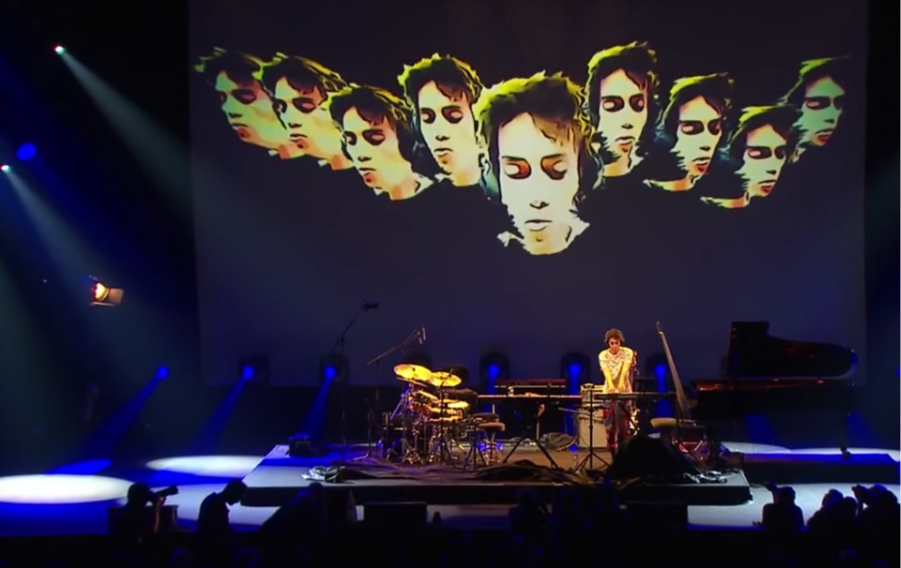

CC BY-SA · John Tilkin, 2016. Jacob Collier performing at Montreux Jazz Festival

Ces fonds photographiques impliquent des défis particuliers que nous devons prendre en compte dans notre recherche. D’abord, il s’agit de contextes de prise de vue très semblables, les sujets étant souvent dans le même cadre comme une scène de spectacle. Ensuite, les clichés sont pris avec une exposition très faible, les scènes étant pour la plupart nocturnes. Enfin, le niveau de granularité exigé par le CHC en termes de description est très élevé. Est-il possible d’utiliser l’IA pour reconnaitre les artistes présents sur scène ? D’obtenir une description sommaire de leurs instruments ? De classer les clichés selon le contexte de leur prise (ex. photo de scène, back-stage, portraits) ?

Rendez-vous au prochain billet de blog pour le savoir !