Par Lorenzo Avellino & Delvinë Racaj

Dans notre précédent billet, nous vous avions promis de revenir avec des résultats concrets sur l’utilisation de l’intelligence artificielle pour la description des archives photographiques du Montreux Jazz Festival. Nous y voilà !

Quelle IA choisir comme collègue de travail ?

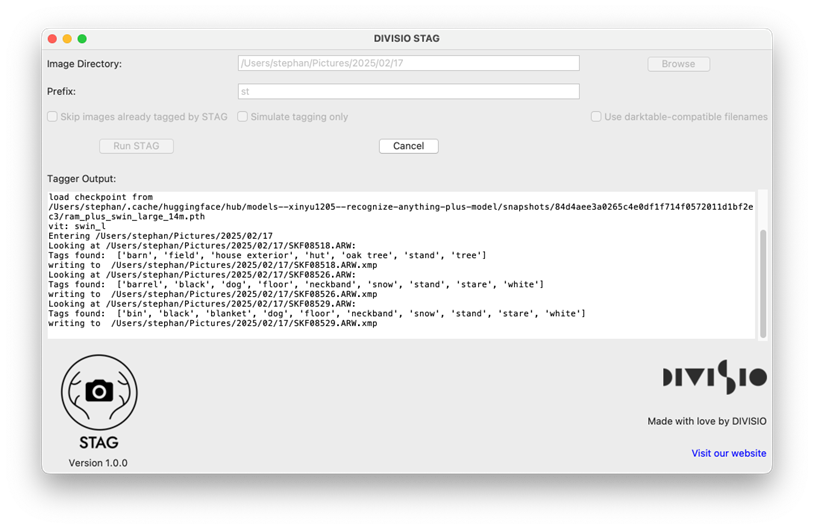

Le choix de l’outil s’est révélé crucial. Les critères définis par le Cultural Heritage & Innovation Center (CHC) étaient stricts : une solution gratuite, open-source, exécutable localement et ne nécessitant aucun entraînement préalable sur les données utilisateur. Ces exigences visaient notamment à sécuriser le traitement automatisé d’œuvres protégées par le droit d’auteur. À l’issue d’une analyse comparative des solutions existantes, nous avons retenu STAG, un logiciel avec interface graphique développé par la société de consulting Divisio qui s’appuie sur recognize-anything, un modèle de reconnaissance d’objets qui répondait à l’ensemble de ces critères.

L’objectif de notre évaluation était double :

Évaluer la concordance entre les descriptions automatisées produites par l’IA et les pratiques descriptives mises en œuvre au sein du CHC.

Examiner les performances de l’outil d’IA en matière de qualité, de précision et de pertinence des tags générés.

Pour l’évaluation, nous avons donc constitué un échantillon aléatoire de 101 photographies déjà indexées manuellement par le CHC. Cette base de référence nous a permis de comparer directement les tags générés par l’IA avec ceux attribués par des humains, mesurant ainsi la précision du modèle dans des conditions réelles d’utilisation.

Des résultats encourageants… à nuancer

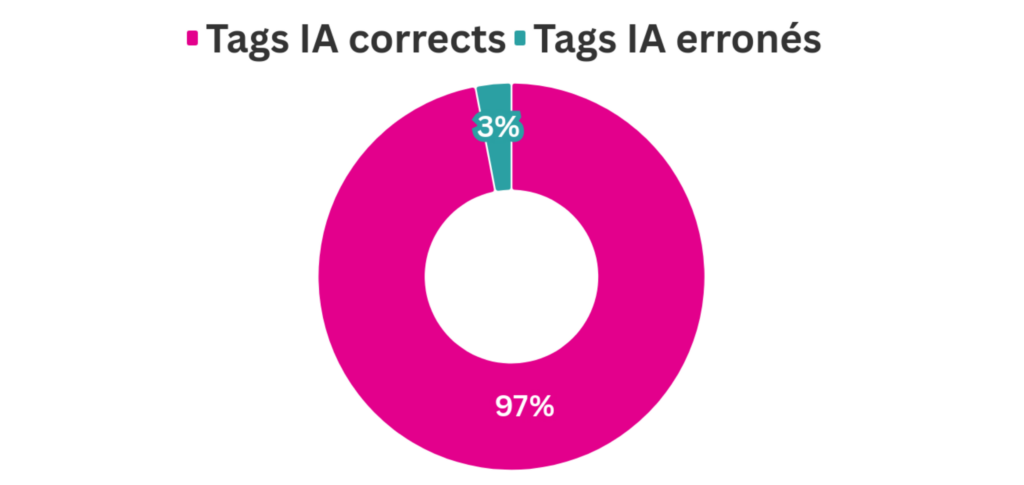

Les résultats se sont révélés particulièrement encourageants. L’analyse met en évidence un taux de précision globalement élevé pour la reconnaissance d’objets, avec seulement 3 % de tags imprécis ou erronés. L’IA identifie correctement les éléments tangibles présents dans les images, tels que les instruments de musique, les vêtements ou les accessoires de scène. Sur l’ensemble de l’échantillon analysé, un seul cas d’hallucination a été observé, phénomène par lequel l’algorithme « invente » des éléments totalement absents de l’image.

Figure 1 : taux de précision des tags IA

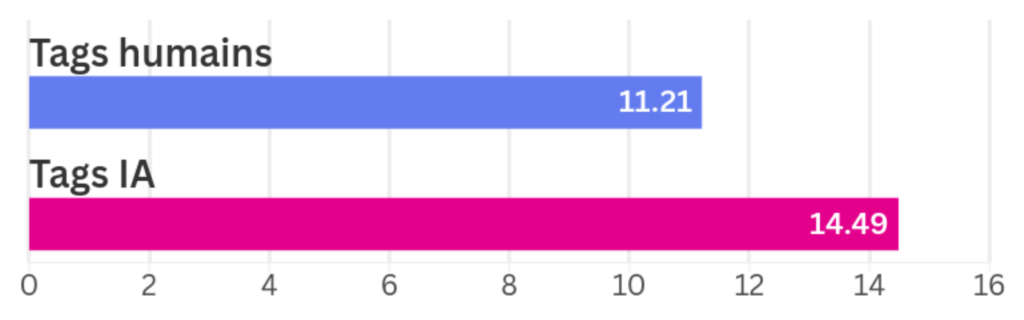

De manière générale, les descriptions produites par l’IA ne s’écartent pas significativement des pratiques archivistiques. Néanmoins, une certaine redondance a été observée dans les tags générés automatiquement, notamment la présence de synonymes et de répétitions n’apportant aucune valeur ajoutée à la description. En moyenne, sur l’échantillon analysé, l’IA a généré 14,49 tags par image, contre 11,21 tags par image selon le protocole archivistique du CHC.

Figure 2 : nombre moyen de tags

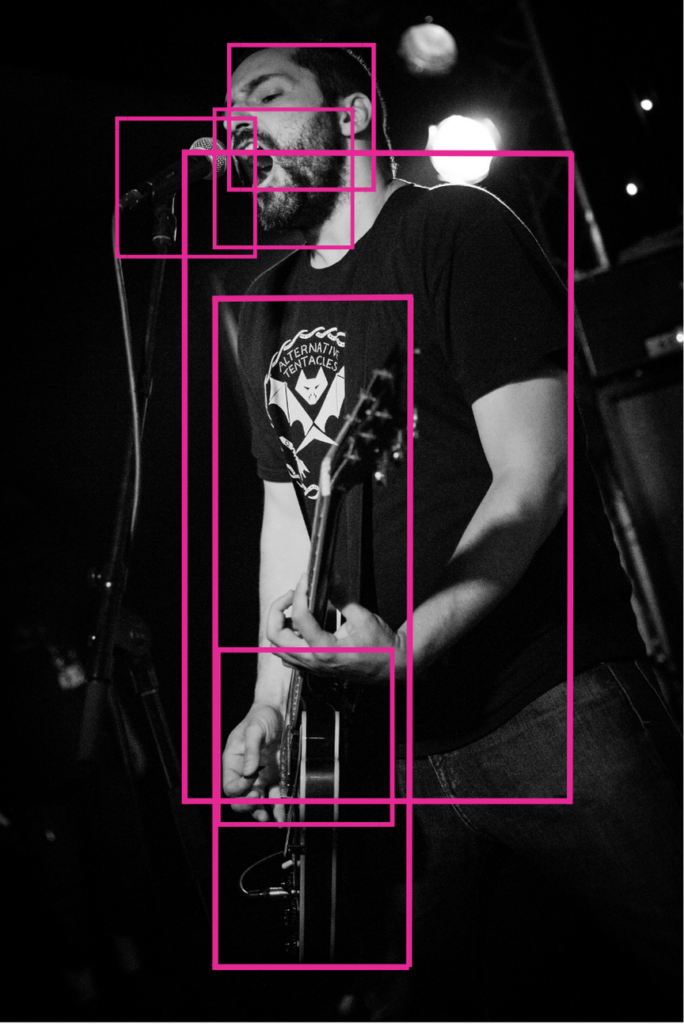

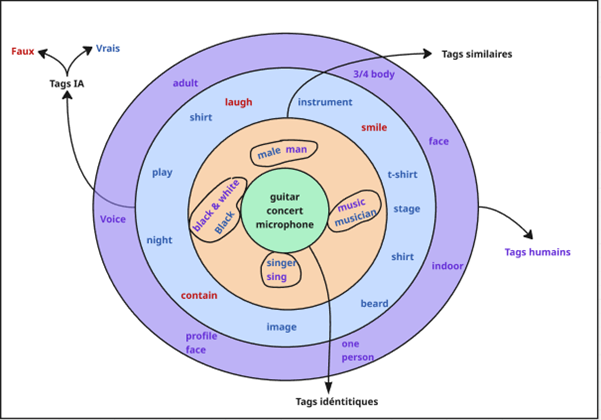

Au-delà des chiffres bruts, notre étude met en évidence plusieurs limitations fondamentales qui interrogent directement l’autonomie possible des outils d’IA en contexte archivistique. Nous allons les illustrer en partant de la photographie suivante :

… et du détail de notre analyse :

Figure 3 : exemple d’analyse de tags

D’abord, si l’algorithme se montre performant dans l’identification d’objets concrets, tels qu’une guitare, un microphone, un t-shirt ou une scène, il peine en revanche à appréhender les dimensions contextuelles et sémantiques que les archivistes jugent essentielles. L’exemple présenté ci-dessus illustre cette limite à travers les tags « laugh » et « smile », qui témoigne d’une reconnaissance insuffisante des expressions faciales.

Cette limitation intrinsèque du modèle se manifeste également dans l’identification des genres. Le modèle d’IA tend à produire des assignations fondées sur des corrélations visuelles stéréotypées, notamment liées aux vêtements ou aux coupes de cheveux (une personne portant une robe serait automatiquement une femme), sans mobiliser d’éléments contextuels pourtant déterminants, tels que l’identité personnelle ou artistique des personnes représentées.

Enfin, l’IA multiplie parfois les variations autour d’un même concept sans hiérarchiser l’information. Cette verbosité algorithmique contraste avec la concision et la précision des indexations humaines, fruits d’une expertise professionnelle, d’un protocole de description et d’une connaissance du domaine spécifique, en l’occurrence celui des festivals de musique et des pratiques artistiques associées.

Et maintenant ?

Ces résultats nuancés permettent de définir plus précisément le rôle que peuvent jouer les outils d’IA dans le traitement des archives photographiques. Notre recherche confirme que le machine learning peut effectivement servir de premier niveau d’indexation, générant rapidement des métadonnées de base qui accélèrent le travail des archivistes, sans pourtant le remplacer.

Les défis méthodologiques, techniques et éthiques identifiés au départ de notre projet se confirment dans les faits. L’enjeu n’est pas de déterminer si l’IA est « meilleure » que l’humain, mais de comprendre comment ces technologies peuvent s’intégrer dans des workflows existants, en complément de l’expertise humaine. L’augmentation exponentielle des archives numériques ne laisse d’autre choix que d’explorer ces pistes, mais notre étude rappelle que cet usage doit rester lucide sur les capacités réelles et les limites des algorithmes.

La suite de nos travaux explorera ces questions d’intégration pratique : comment optimiser l’interaction entre traitement automatique et validation humaine ? Quels critères de qualité définir pour évaluer la pertinence des tags générés ? Comment maintenir la visibilité du travail intellectuel des archivistes face à la prolifération de métadonnées automatisées ? Des questions qui nous accompagneront dans les phases finales de cette recherche passionnante.

Bibliographie

Divisio, 2025. STAG [logiciel]. Version 1.0.1 du 25 mars 2025. GitHub. Disponible à

l’adresse : URL [consulté le 12 décembre 2025]