Quand vous utilisez le moteur de recherche Google, vous passez par une IA qui permet d’analyser la sémantique de votre requête afin de vous offrir des résultats les plus pertinents possible (1). Instagram utilise également l’intelligence artificielle pour vous proposer de nouveaux comptes auxquels vous abonnez, modifier automatiquement votre flux d’actualité selon vos centres d’intérêts du moment et bien plus encore (2). L’intelligence artificielle nous encercle de plus en plus sans même que l’on s’en aperçoive. Aujourd’hui des projets d’innovation centrés sur l’IA sont régulièrement menés et chaque profession en est impactée. Cependant, dans ce billet de blog, nous allons essentiellement nous concentrer sur le domaine médical, car chaque innovation dans ce secteur à le potentiel de sauver de nombreuses vies. Actuellement, il existe déjà de multiples applications pratiques comme en Chine où les médecins combattant le COVID-19 se voient épauler par des robots.

L’élève qui dépasse le maître

Plusieurs études ont déjà pu démontrer que dans certains domaines, les machines sont plus performantes que les professionnels de la santé. Comme par exemple, cette recherche (3) démontrant l’efficacité des algorithmes dans la détection de mélanomes. Cependant pour mettre au point de tels algorithmes, il est fondamental que l’IA ait été entraînée afin d’apprendre à déceler les anomalies. Pour cela, il existe différents types d’apprentissage, mais la plupart d’entre eux nécessitent de grands échantillons. Comme par exemple dans le cadre d’une étude (4) qui a utilisé plus de 100 000 images de rétines. Cette recherche visait à développer une IA permettant de dépister des cas de rétinopathie diabétique.

Cette dépendance aux données est un frein pour le développement de l’intelligence artificielle, surtout en médecine. Tout d’abord, il faut pouvoir avoir accès à ces données et dans le domaine de la santé ça n’est pas toujours évident, car ce sont des données sensibles et personnelles (5). Ces dernières sont également concernées par la réglementation générale sur les données personnelles (RGPD) et doivent donc impérativement être anonymisées (6). Dans un deuxième temps, il faut que ces données soient parfaitement propres et bien annotées pour pouvoir les comprendre. Cependant, en médecine, c’est un grand problème, car dans certains secteurs, il n’existe pas encore de standardisation sur les données médicales. Elles peuvent donc être structurées et stockées de façons drastiquement différentes d’un médecin à un autre, ce qui augmente grandement la complexité d’exploitation de ces dernières (7).

Imaginons maintenant, que malgré tous les problèmes énoncés plus haut, nous ayons réussi à accéder aux données qui nous intéressent … et bien toutefois dans certains domaines cela ne serait pas suffisant. Il faudrait également que ces jeux de données soient suffisamment diversifiés ceci afin d’éviter les biais (8). Par exemple, avec l’algorithme permettant de distinguer les mélanomes et bien si le jeu d’entraînement est constitué en majorité d’image de peau blanche alors l’IA aura de la peine à distinguer les anomalies sur une peau foncée. Ceci aura donc un impact direct sur l’efficacité de l’algorithme selon le teint de peau du patient. Malheureusement, les pays bénéficiant actuellement des meilleurs soins médicaux et donc de base de données de santé bien fournis sont majoritairement des pays occidentaux. En outre, étant donné que les algorithmes seront entraînés à partir de ces données, il y a de grandes chances que ceci risque de créer un déséquilibre dans l’efficacité des algorithmes selon les origines ethniques (9).

Dans le prolongement de ce sujet, je vous conseille cet article qui traite des biais algorithmiques en présentant quelques exemples concrets.

La boîte magique

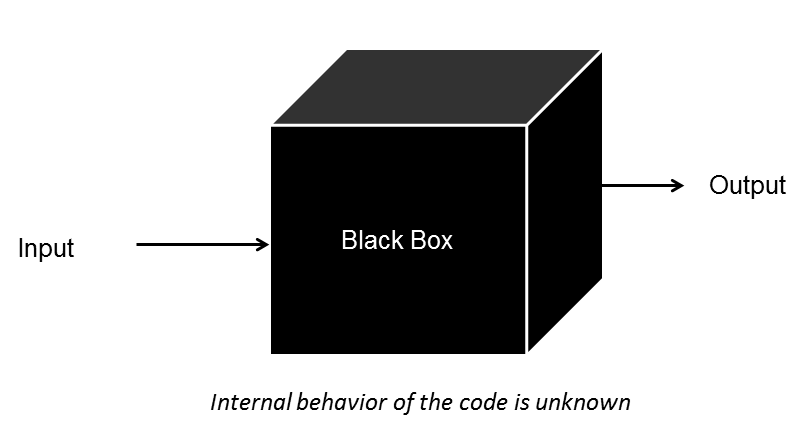

Vous l’aurez donc compris, le fait de récolter des données de qualité est fondamental, mais complexe et fastidieux. Cependant, tout ce travail en vaut la peine, car comme vu précédemment il a déjà été prouvé qu’il existe des algorithmes dépassant les performances obtenues par des professionnels du domaine en question. En revanche, un problème subsiste, car dans de nombreux secteurs médicaux, il n’existe pas encore d’algorithme capable d’expliquer la démarche qui lui a permis d’émettre le diagnostic (9). On appelle cela une boîte noire, c’est-à-dire que l’on sait ce que l’on passe en entrée et ce que l’on reçoit en sortie, mais il n’y a aucun moyen de savoir ce qui s’est passé entre les deux. Ce phénomène s’explique par la complexité de ces algorithmes qui effectuent un nombre très important de micro-raisonnements qui mit bout à bout permettent à la machine d’émettre son diagnostic. Cependant, ces derniers sont si nombreux qu’il est impossible pour un humain de les comprendre, d’où la boîte noire.

Si l’on se met à la place de la personne qui va utiliser l’IA, c’est assez perturbant, car on obtient un résultat et le seul indicateur justifiant sa validité est un pourcentage indiquant la probabilité que le diagnostic soit correct. Cette situation est très problématique, car tout d’abord, si un médecin fait une erreur, il sera possible de comprendre ce qui s’est passé et apprendre de cette erreur. En revanche, avec des algorithmes aussi complexes, il est quasiment impossible, en cas de faute, d’en tirer quelque chose (10). De plus, ce problème de boîte noire pose de nombreuses questions juridiques, comme par exemple, dans le cas d’un diagnostic erroné qui aurait été effectué par une IA, qui serait en tort (11) ? Un médecin ne peut pas prendre une telle décision sans avoir pu suivre le raisonnement ou du moins les points clé qui auraient poussé la machine à en arriver à cette conclusion (6). Pour cette raison, temps que ce problème de boîte noire n’aura pas été résolu de nombreux domaines médicaux n’implémenteront pas ce genre de technologie car trop problématique.

Pour conclure, l’intelligence artificielle est en train de révolutionner la médecine, cependant, il reste encore de nombreux ajustements à effectuer avant que les IA puissent pleinement être intégrées dans le domaine de la santé.

Bibliographie

- SEMJI. RankBrain, l’IA Google qui révolutionne le SEO [en ligne]. [Consulté le 29 novembre 2020]. Disponible à l’adresse : https://semji.com/fr/blog/rankbrain-ia-google-seo/#Un_cerveau_artificiel_mis_au_service_de_vos_recherches

- RANGAIAH, Mallika, 2020. How Instagram Uses AI and Big Data Technology ? Analytics steps [en ligne]. 17 février 2020. [Consulté le 29 novembre 2020]. Disponible à l’adresse : https://www.analyticssteps.com/blogs/how-instagram-uses-ai-and-big-data-technology

- PHILLIPS, Michael, 2019. Detection of Malignant Melanoma Using Artificial Intelligence: An Observational Study of Diagnostic Accuracy. National Center for Biotechnology Information [en ligne]. 31 décembre 2019. [Consulté le 28 novembre 2020]. Disponible à l’adresse : https://www.ncbi.nlm.nih.gov/pmc/articles/PMC6936633/

- INSERM, 2016. Un algorithme informatique au service des ophtalmologues. Inserm [en ligne]. 11 février 2020. [Consulté le 28 novembre 2020]. Disponible à l’adresse : https://www.inserm.fr/actualites-et-evenements/actualites/algorithme-informatique-service-ophtalmologues

- JANIN, Arnaud, 2019. IA, comment améliorer la qualité des données en santé. Décision Santé [en ligne]. 7 février 2019. [Consulté le 28 novembre 2020]. Disponible à l’adresse : https://www.decision-sante.com/actualites/breve/2019/02/07/ia-comment-ameliorer-la-qualite-des-donnees-en-sante_28234

- CHARLET, Jean, 2018. Intelligence artificielle et santé. Inserm [en ligne]. 6 juillet 2018. [Consulté le 28 novembre 2020]. Disponible à l’adresse : https://www.inserm.fr/information-en-sante/dossiers-information/intelligence-artificielle-et-sante

- KERRAVALA, Zeus, 2018. Healthcare CIOs should focus on data quality to maximize the value of artificial intelligence. CIO [en ligne]. 26 octobre 2018. [Consulté le 28 novembre 2020]. Disponible à l’adresse : https://www.cio.com/article/3316936/healthcare-cios-should-focus-on-data-quality-to-maximize-the-value-of-artificial-intelligence.html

- LYNCH, Shana, 2020. The Geographic Bias in Medical AI Tools. Human-Centered Artificial intelligence Stanford University [en ligne]. 21 septembre 2020. [Consulté le 29 novembre 2020]. Disponible à l’adresse : https://hai.stanford.edu/blog/geographic-bias-medical-ai-tools

- KELLY, Christopher J., 2019. Key challenges for delivering clinical impact with artificial intelligence. Bio Medical Central [en ligne]. 29 octobre 2019. [Consulté le 28 novembre 2020] Disponible à l’adresse : https://bmcmedicine.biomedcentral.com/articles/10.1186/s12916-019-1426-2

- WALTER, Michael, 2020. Will AI’s ‘black box’ problem ever be solved ? AI in Healthcare [en ligne]. 10 mars 2020. [Consulté le 28 novembre 2020]. Disponible à l’adresse : https://www.aiin.healthcare/topics/medical-imaging/ai-black-box-data-healthcare-problem-imaging

- STANLEY, Louise, 2020. ‘Black box medicine’ and machine learning. Birmingham Health Partners [en ligne]. 16 juin 2020. [Consulté le 28 novembre 2020]. Disponible à l’adresse : https://www.birminghamhealthpartners.co.uk/black-box-medicine-and-machine-learning/

Laisser un commentaire